摘要

生成式 AI 正在改變遊戲規則,重新定義創造力、自動化,甚至是網絡安全的未來。像 GPT-4 和 DeepSeek 這樣的模型能夠生成類人文本、精美圖片以及軟件代碼,為企業和個人打開全新的可能性。然而,強大的能力伴隨着巨大的風險。網絡安全專家越來越關注生成式 AI,不僅因為其技術突破,還因為它帶來的潛在安全隱患。在本文中,我們將探討生成式 AI 的複雜性,包括其運作方式、安全風險,以及企業如何有效降低這些風險。

生成式 AI:創新與風險並存的前沿技術

生成式 AI 是人工智能的一個重要分支,能夠自動生成文本、圖像、音頻、視頻乃至代碼。不同於傳統 AI 側重數據分析和分類,生成式 AI 依託大規模訓練數據和深度學習技術,可以創造全新內容,其核心技術包括:

- 大語言模型(LLMs):如 GPT-4、DeepSeek,具備強大的語言理解與生成能力。

- 神經網絡:模擬人腦思維模式,通過學習數據中的模式進行推理。

- 強化學習與微調(Fine-Tuning):透過行業數據優化模型,使其更契合特定應用場景。

當前主流的生成式 AI 技術涵蓋多個領域:

- GPT-4(OpenAI):擅長生成自然流暢的文本。

- DeepSeek(深度求索):專注中文語境優化,提升 AI 生成能力。

- DALL-E:可根據文本描述生成精細圖像。

- MidJourney:以藝術風格圖像創作見長。

這些技術已廣泛應用於媒體、設計、醫療、內容創作和軟件開發等領域,大幅提升生產效率。然而,生成式 AI 的發展也帶來了新的挑戰和風險。

生成式 AI 的安全風險

生成式 AI 帶來了巨大的機遇,但同時也引發了一系列網絡安全威脅。從數據洩露到 AI 生成語音和深度偽造(Deepfake),這種技術對企業和政府機構構成重大風險。以下是生成式 AI 可能帶來的主要安全隱患:

數據洩露與私隱侵犯

生成式 AI 面臨的最嚴重問題之一就是數據洩露。由於這些模型是在海量數據集上訓練,它們可能會無意中復現訓練數據中的敏感資訊,從而侵犯用戶私隱。例如,OpenAI 曾表示,大型語言模型可能會在 1-2% 的情況下無意暴露輸入數據,其中可能包含個人身份資訊(PII)。對於受嚴格數據監管的行業(如醫療或金融領域),數據洩露可能會導致巨大的財務損失或聲譽損害。

惡意代碼生成

網絡犯罪分子可以利用生成式 AI 建立惡意文本,包括惡意軟件(Malware)和勒索軟件(Ransomware)腳本。一些攻擊者已開始使用 GPT 生成複雜的網絡釣魚(Phishing)電郵,甚至直接編寫攻擊代碼,降低了黑客入侵的技術門檻。根據 CheckPoint 的報告,高級持續性威脅(APT)組織已開始使用 AI 生成的網絡釣魚腳本,以規避傳統安全工具的檢測。

模型反演攻擊(Model Inversion Attacks)

在模型反演攻擊中,攻擊者可以通過訪問 AI 模型,推測或恢復模型的訓練數據。這可能導致敏感數據(甚至是匿名數據)被洩露,而一旦這些數據落入網絡犯罪分子手中,他們可能獲取專有算法或用戶個人資訊。例如,Securiti 研究人員曾演示過,在缺乏安全防護的情況下,攻擊者可以透過生成式 AI 模型提取私人資訊。

深度偽造(Deepfake)與詐騙

深度偽造(Deepfake)技術的精度正不斷提高,並被用於身份冒充、虛假資訊傳播和社交工程攻擊。

- AI 語音克隆可以讓黑客模仿公司高管或知名人士的聲音,從而實施詐騙。

- 偽造影片可能被用於虛假新聞、欺詐性廣告或政治操縱。

根據普華永道(PwC)的一項研究,到 2026 年,深度偽造技術每年可能造成高達 2.5 億美元的損失,主要來源於詐騙與錯誤資訊傳播。

偏見與倫理問題

生成式 AI 依賴於既有數據進行訓練,因此可能會固化社會偏見。如果訓練數據中存在歧視性內容,模型生成的結果可能會不公平或帶有歧視性,從而影響決策的公正性。

- 在企業層面,這種偏見可能會帶來品牌風險、法律訴訟和合規問題。

- 在受監管行業,如招聘、金融和醫療,AI 生成的不公平決策可能觸犯法律,令企業面臨法律與倫理責任。

如何降低生成式 AI 的安全風險

面對當前及未來的 AI 安全挑戰,企業和機構必須採取全面的安全策略來應對生成式 AI 可能帶來的風險。以下是一些關鍵的緩解措施:

數據私隱保護與差分隱私(Differential Privacy)

數據清理是減少 AI 訓練數據洩露風險的最佳方法之一。企業應在使用數據之前,對數據集進行清理,去除所有可識別的個人資訊,以防止 AI 模型無意中洩露敏感數據。此外,差分隱私技術(Differential Privacy)可以進一步增強數據保護,它能確保模型在生成內容時不會暴露單一用戶的數據。目前,Google 和 Apple 等公司已經在其大規模 AI 模型中採用了差分隱私來保護用戶資訊。

AI 審計與持續監控

定期審核 AI 模型,並持續監測其輸出,有助於發現潛在的攻擊或安全風險。例如,AI 可能會產生偏見內容或無意中洩露敏感資訊,企業需要建立 AI 監管體系,以確保 AI 技術的合理應用。

- 第三方 AI 審計(如 PwC 建議的外部評估)可以幫助組織符合私隱法規和安全要求,並確保 AI 系統的公平性和透明度。

- AI 監測系統可以實時檢測異常行為,防止 AI 生成誤導性或有害內容。

加密與訪問控制

限制對 AI 模型的訪問權限至關重要。企業可以採用基於角色的訪問控制(RBAC),確保只有授權用戶才能使用 AI 系統。此外,AI 生成的輸出數據和訓練數據在傳輸過程中應進行加密,防止數據在傳輸過程中被竊取或篡改。

引入「人類監督」(Human-in-the-Loop)機制

在 AI 生成內容的關鍵環節加入人工審核,可以有效減少偏見、不當或惡意內容的產生。

- 透過人類監督(Human-in-the-Loop),企業可以確保 AI 生成的內容符合道德標準,並避免錯誤資訊的傳播。

- 人工審核機制亦可提高 AI 系統的可信度,降低 AI 自動化帶來的潛在風險。

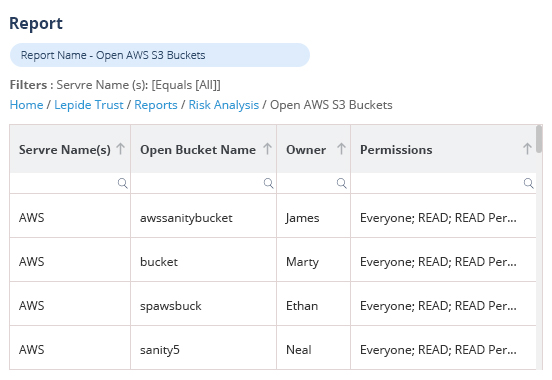

使用 Lepide 保障生成式 AI 的安全性

面對生成式 AI 帶來的安全挑戰,Lepide 數據安全平台提供了一套全面且主動的解決方案,有效降低相關風險。Lepide 能夠實時監控數據交互、用戶權限及訪問活動,協助企業在安全威脅發生之前及時檢測並響應可疑行為,防止安全事件升級為嚴重的數據洩露。

Lepide 的核心優勢之一在於能夠防止未經授權的訪問,最大程度地降低 AI 驅動環境中的數據洩露風險。透過詳細的審計日誌,企業可以追蹤敏感數據的所有變更,確保對 AI 相關數據使用的可視化管理與全面掌控。

除了安全監控,Lepide 還在合規性管理方面發揮關鍵作用。它能夠自動化生成合規報告,並提供自定義安全警報,幫助企業遵守 GDPR、CCPA、HIPAA 等嚴格的數據私隱法規,降低因違規導致的法律及經濟風險,確保敏感數據始終受到嚴格保護。

此外,Lepide 採用 AI 驅動的異常檢測技術,能夠識別並響應異常的數據訪問模式。這種主動防禦策略有助於及時發現內部威脅、AI 濫用或潛在的網絡攻擊,確保企業能在安全事件發生前採取應對措施。

透過集成 自動化風險評估、精細化訪問控制及先進的威脅情報,Lepide 讓企業能夠在確保數據安全與合規的前提下,放心採用生成式 AI 技術。

如果您對此感興趣,歡迎您關注我們獲取更多文章資訊,如有任何問題,也歡迎聯絡我們!