一、前言

《一般資料保護規定》(General Data Protection Regulation, GDPR)是目前全球最嚴格的資料保護法之一,旨在確保企業與組織妥善處理個人資料並尊重個人隱私。

只要企業有收集、處理或儲存歐盟公民個人資料的行為,即受 GDPR 約束。若未能合規,不僅可能遭受高額罰款,也會對企業聲譽與業務造成嚴重衝擊。

對汽車產業而言,從 ADAS(先進駕駛輔助系統)開發到自駕車測試,都牽涉大量影像與感測資料,因此了解並遵守 GDPR 顯得格外重要。本文將分享汽車產業中最常見的五大 GDPR 誤區

誤區 1:非必要資料就不用匿名化?

GDPR 的核心原則之一是「資料最小化(Data Minimization)」,但這個概念經常被誤解。所謂資料最小化,是指企業只能收集、處理與保存為達成特定目的所必需的個人資料,不得超出需求範圍或保留過久。

然而,這並不代表可以跳過匿名化處理。舉例來說:在開發 ADAS 系統時,確實需要大量行車影像,但多數情況下僅需分析車輛行為與路況資料,並不需要清晰的人臉或車牌。

若這些影像資訊與開發目的無關,仍應進行匿名化,以保障個資安全並避免未授權使用。

誤區 2:資料量龐大,識別個人風險不高

許多企業誤以為「資料量大,就難以識別個人,風險自然不高」,但事實並非如此。

即使在公共空間拍攝的影像,也可能涉及個資,且 GDPR 預設企業無法預判資料是否會被他人用於識別個人。

舉例來說,若第三方(如研究人員、媒體或 AI 平台)出於興趣或其他目的對資料進行比對分析,仍有可能識別出特定人物,導致隱私外洩。因此,無論資料集多龐大,都必須事先落實匿名化與存取控管機制。

誤區 3:加密就等同匿名化?

這是最常見的誤區之一。根據 GDPR 定義,「加密」(Encryption)屬於假名化(Pseudonymization),而非真正的匿名化。加密僅是讓資料暫時無法被直接識別,但若擁有金鑰或足夠技術能力,仍有機會還原出原始資料。

此外,今日安全的加密算法,未來也可能因技術進步而被破解。因此,加密並不能取代匿名化,兩者在法規上有明確區分。

誤區 4:貼上錄影提示貼紙即可視為取得授權

有些企業在測試車輛上張貼「本車正在錄影」的提示貼紙,認為只要公開告知就算取得使用者的「同意」。

但根據 GDPR 要求,資料處理必須獲得明確同意(Explicit Consent)。單純張貼提示或網站公告僅屬「被動告知」,並不構成有效授權。

在汽車產業場景中,ADAS 影像資料往往涉及大量路人與車輛,要逐一取得書面或口頭同意幾乎不可能,因此更需要以匿名化技術作為替代。

誤區 5:資料只在公司內部使用,就不用匿名化?

「我們的資料只在公司內部分析,不用匿名化。」這樣的想法是錯誤的。

即便資料僅限內部使用,仍存在兩大風險:

1. 外部駭客入侵導致資料外洩

2. 內部員工在非授權情況下識別出特定個體

GDPR 對於敏感地點(如醫院、宗教場所等)特別嚴格,任何導致個資外洩的事件,即使非惡意,也可能導致罰款與信任危機。

結語

綜觀上述五大誤區,可以發現它們都無法迴避 GDPR 的核心要求,即使符合「資料最小化原則」,也不代表能免除匿名化義務。

對汽車產業而言,匿名化早已不只是法規遵循,更是產品開發品質與企業信任度的保障機制。

然而,現實挑戰在於:

- 傳統的模糊化方式容易破壞影像品質,導致 AI 模型訓練資料失真

- 過度遮蔽會降低影像的研究與分析價值;

- 不同地區法規要求差異大,企業難以兼顧速度與合規。

在這樣的背景下,企業需要的不只是「把資料打碼」,而是一套兼顧合規、安全與可用性的匿名化方案。

💡 Brighter AI:結合法規遵循與影像可用性的最佳平衡

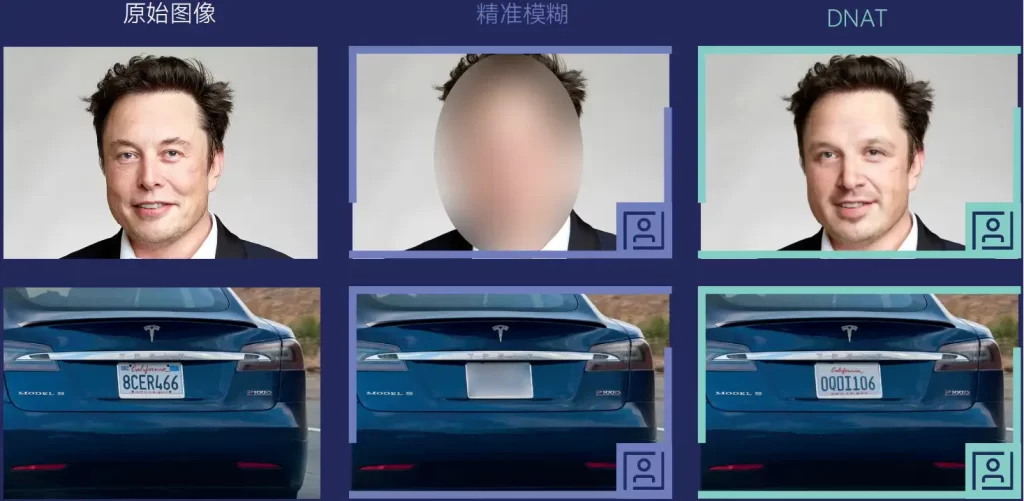

Brighter AI 的「深度自然匿名化技術(DNAT, Deep Natural Anonymization Technology)」運用生成式 AI 將人臉與車牌自動轉換為虛擬替代影像,在維持影像真實感與資料結構的同時,徹底消除可識別個資。

與傳統的馬賽克或模糊化不同,DNAT 具備以下優勢:

- 高精準度 — 能精確辨識多場景中的人臉與車牌位置

- 自然保真度 — 生成的虛擬影像自然、不影響 AI 模型辨識

- 全流程合規 — 完全符合 GDPR 及歐洲資料保護標準

- 可擴充性高 — 支援車載影像、智慧城市監控、ADAS 開發等多種應用。

Brighter AI 不僅幫助企業「符合法規」,更讓資料在合法的前提下持續創造研發與商業價值。

宏虹將提供您所需的任何支援!

專業的宏虹團隊會第一時間回應,為您提供最佳的服務,解決您的一切問題

想深入了解更多

想深入了解更多