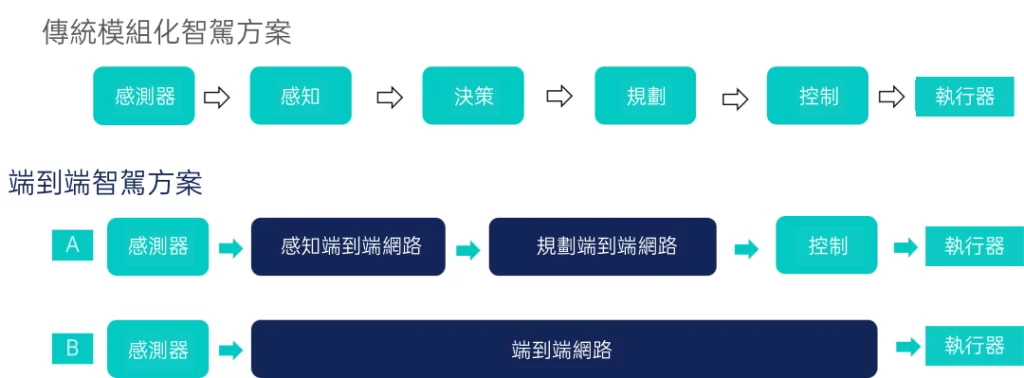

一、從規則式到學習式,智駕仿真測試面臨的關鍵轉變

隨著智慧駕駛技術持續演進,端到端(End-to-End)解決方案逐漸成為產業關注焦點,愈來愈多開發者與車廠開始將端到端智駕架構導入量產車型。相較於過去以感知、決策、規劃與控制為核心的規則驅動(rule-based)模組化架構,端到端學習式(learning-based)方法能有效因應規則難以窮舉、ODD(操作設計域)邊界模糊,以及系統擴充與維護成本高等實務限制,成為新一代自動駕駛系統的重要發展方向。

端到端架構的優勢在於其整體性與彈性。透過大量資料學習潛在規律,系統可具備更佳的泛化能力,以適應多樣且高度複雜的道路情境;同時,模型可直接將感測器輸入映射為車輛控制輸出,降低傳統模組分離架構中可能產生的資訊流失與誤差累積風險。再者,端到端系統具備持續學習與迭代能力,能隨著資料累積與訓練更新,動態因應法規變化與新型場景需求。

二、端到端智駕仿真為何成為「系統級挑戰」?

整體而言,端到端智慧駕駛方案在模型能力與系統整合上具備明顯優勢,但對既有仿真測試架構而言,卻帶來結構性的重大挑戰。在傳統模組化智駕系統中,感知模組與規劃/控制(規控)模組之間具有明確且可分離的介面,因此不論是在 SIL(Software-in-the-Loop)或 HIL(Hardware-in-the-Loop)仿真環境中,皆可繞過感知模組,直接針對規控邏輯進行測試與驗證。即便輸入為合成影像或低置信度的點雲資料,也不影響規控模組本身的測試流程。

然而,端到端智駕架構的導入,使感知與規控不再以顯性介面區隔,模型直接從感測器輸入資料產生控制輸出結果,導致原有以模組切分為基礎的 SIL/HIL 仿真方法難以沿用,既有仿真流程勢必需要重新設計與重構。面向端到端智駕系統的仿真測試,必須從感測器輸出資料層級切入,建構一套具備高置信度、一致性良好、場景覆蓋完整,且能有效支援故障注入的全鏈路閉環仿真架構。

三、面向端到端智駕的仿真架構設計思路

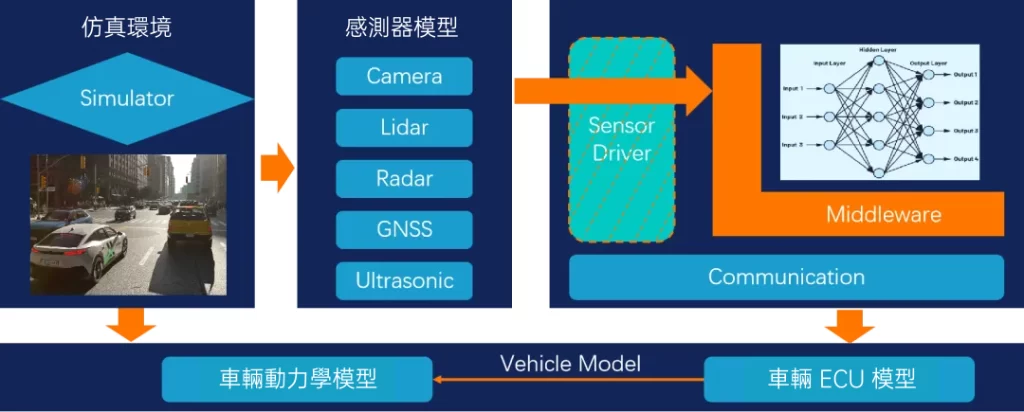

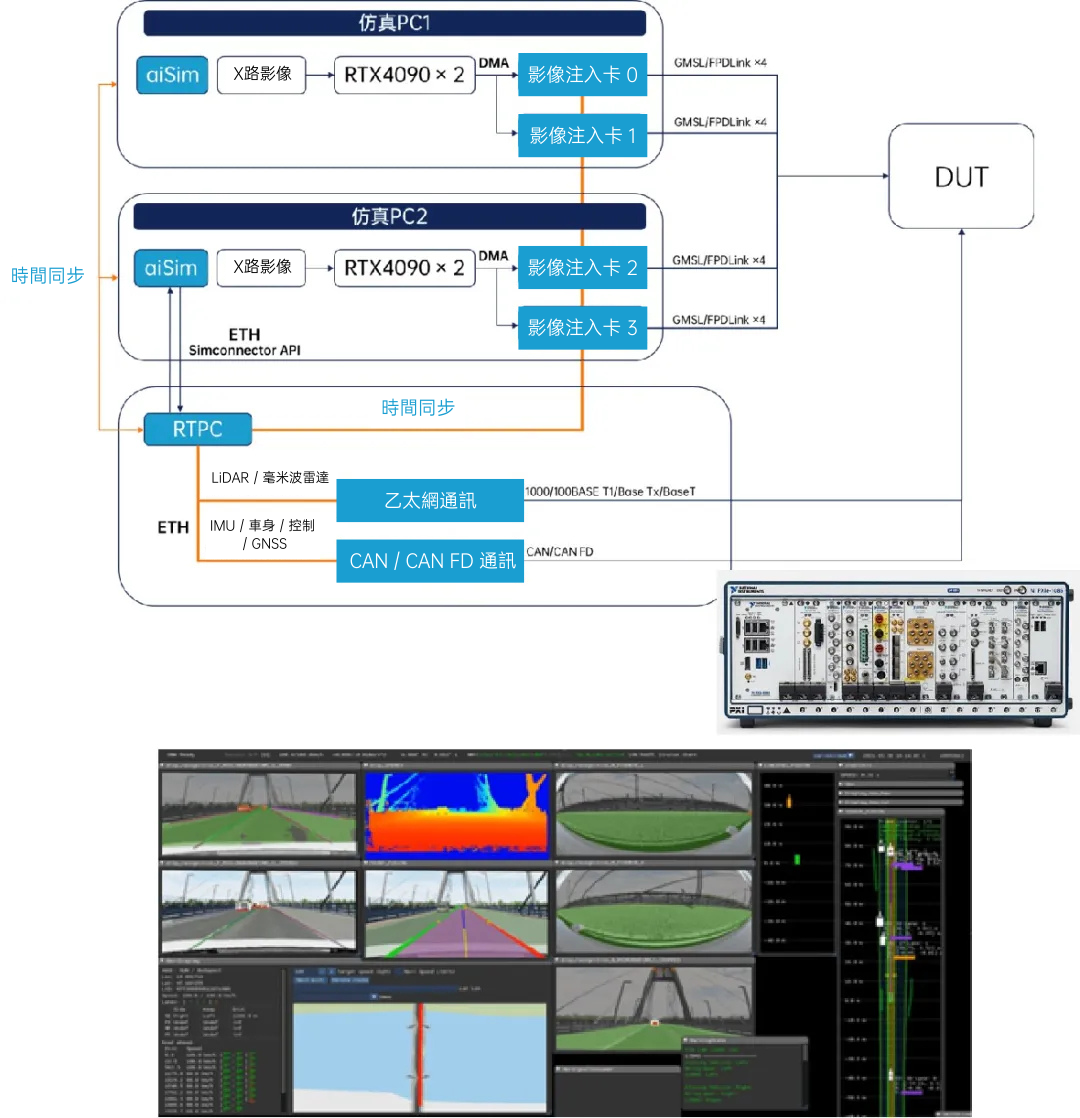

針對上述挑戰,我們進一步探索並實作一套適用於端到端智慧駕駛的仿真解決方案,並在仿真引擎與資料傳輸機制上進行大幅優化,其整體架構如下圖所示。本方案充分運用智慧駕駛系統中的中介軟體(middleware)技術,將仿真引擎所產生的感測器原始資料(部分為結構化資料),直接傳遞至智駕應用層進行處理。

透過此設計,可有效繞過實體感測器硬體與其驅動程式,大幅縮短仿真資料的傳輸鏈路,並降低因硬體相依所衍生的系統適配與除錯複雜度。在加速整體開發時程的同時,也能顯著降低端到端智駕仿真系統的建置與維運成本,為後續大規模測試與驗證提供更具效率與可擴展性的基礎架構。

本方案的核心架構以aiSim 仿真引擎為基礎,採用XIL(Model-/Software-/Hardware-in-the-Loop)架構設計,並提供高度開放且具彈性的 API 介面,以滿足不同階段與不同層級的仿真測試需求。無論是感測器模型、車輛動力學,或是場景建構,皆可透過對應的功能模組進行整合與實作。

在系統架構上,aiSim 可與 ADAS/自動駕駛系統、中介軟體(如 ROS)、感測器模型與車輛動力學模型進行串接,並透過標準化的感測器 API、動力學 I/F 與場景 API,實現跨模組、跨平台的仿真資料交換。此架構同時支援與第三方測試框架與雲端基礎設施整合,為大規模測試與自動化驗證提供彈性部署能力。

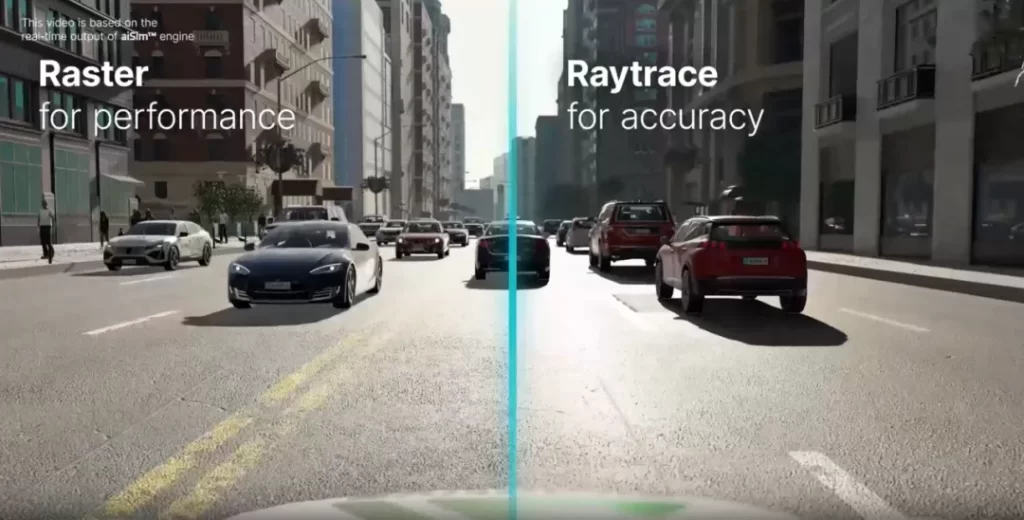

在視覺與感測仿真方面,aiSim Air 引擎support sth.Raster、Ray Tracing等多種渲染技術,並相容3DGS/NeRF等先進場景重建技術,能在兼顧渲染效能的同時,進一步提升影像與感測資料的真實度。此外,aiSim 能針對不同感測器與天候條件,提供高度一致且可重現的仿真結果,作為符合ISO 26262 ASIL-D認證需求之仿真工具基礎,確保測試結果在安全性與一致性上的可靠性。

四、靈活且先進的場景建構方案

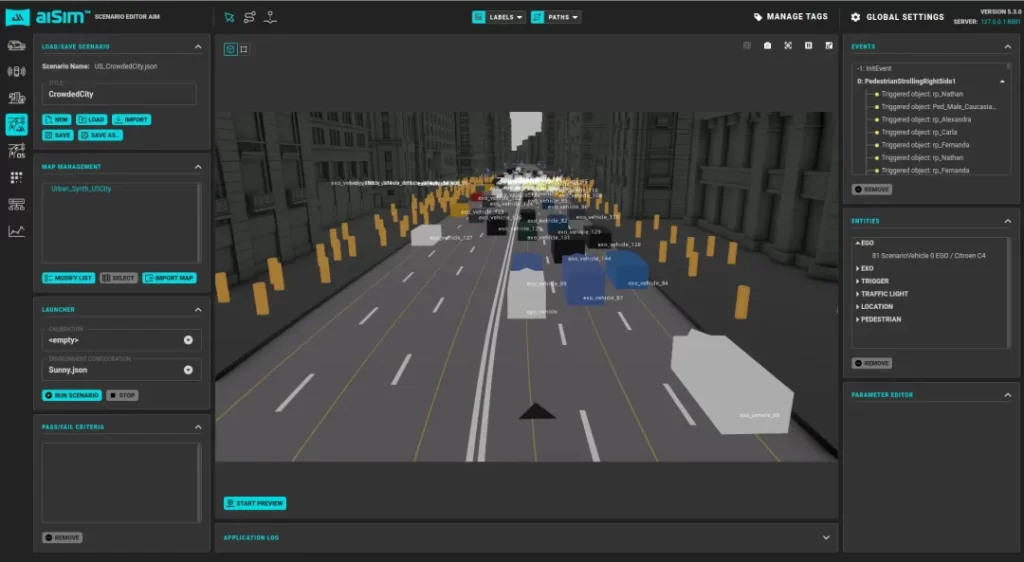

此外,我們導入多種先進的場景建構機制,大幅提升仿真測試在彈性、覆蓋度與可擴充性上的表現。透過互動式圖形化場景編輯工具,支援OpenSCENARIO以及 aiSim 自定義的AimScenario兩種場景格式,可有效縮短場景建模與反覆調整的作業時間。

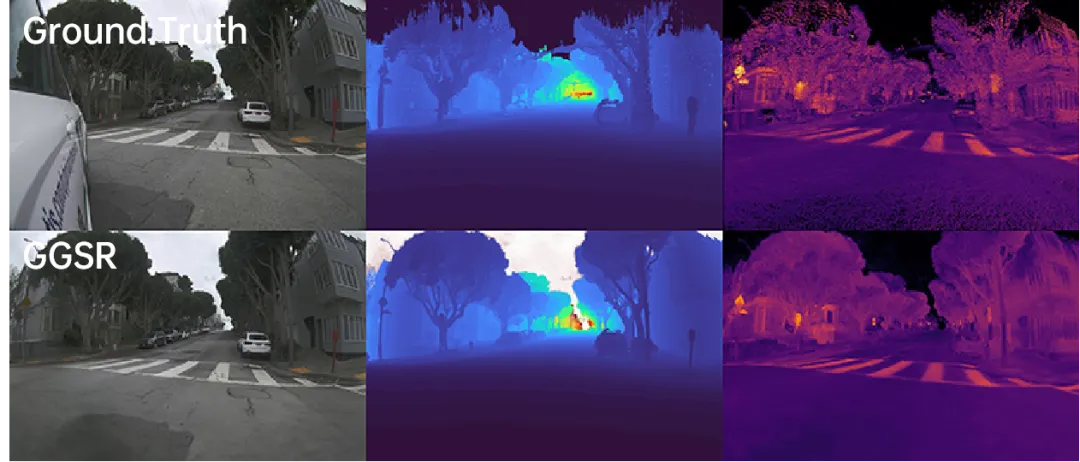

在場景細節層面,系統支援高斯殘差渲染器(GSR, Gaussian Splatting Renderer),可在 3D 重建場景中動態插入物件、優化環境光照與天氣條件,並有效降低陰影失真,修正鏡頭視角下可能產生的非一致性問題,提升感測資料的整體可信度。

非一致性修正

三維重建場景天氣環境編輯

任意視角下多模態效果圖

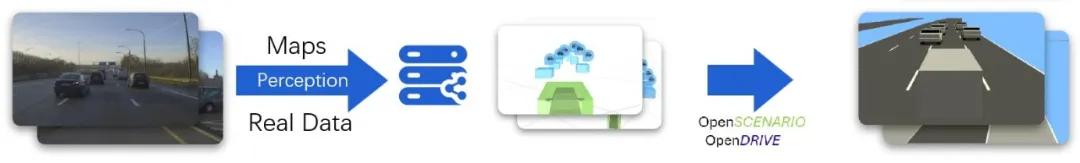

針對真實世界資料導入,LogSim2WorldSim 模組可透過雲端自動化處理與分析原始行車資料,實現以 Euro NCAP 等法規測試場景為基礎的場景切片、重建、預測與回放功能,協助開發團隊快速建立高品質仿真場景。

LogSim2WorldSim方案轉換流程

在完成場景建構後,系統可進一步針對VRU(弱勢用路人)、建築物、道路標誌、交通流量與天氣條件等靜態與動態要素,進行場景邊界條件探索,確保端到端智駕模型在各類極端與關鍵情境下皆能獲得充分測試覆蓋。

透過高度模組化的場景泛化機制,使用者可依需求組合不同交通狀態、道路結構與動態事件,快速生成大量高品質測試案例,顯著提升仿真測試效率,並降低人工建模與驗證成本。

五、高擬真物理感測器模型

在感測器仿真層面,本方案透過完整的物理相機、光達(LiDAR)與毫米波雷達模型庫,可快速完成感測器配置與關鍵參數調校,支援多樣化測試需求。

同時,系統可精準模擬 HDR(高動態範圍)、動態模糊、曝光差異、鏡頭耀光(Lens Flare)等多種真實視覺效果,確保在不同駕駛情境與天候條件下,皆能進行高擬真度的感測測試與驗證。

不同天氣條件下鏡頭效果

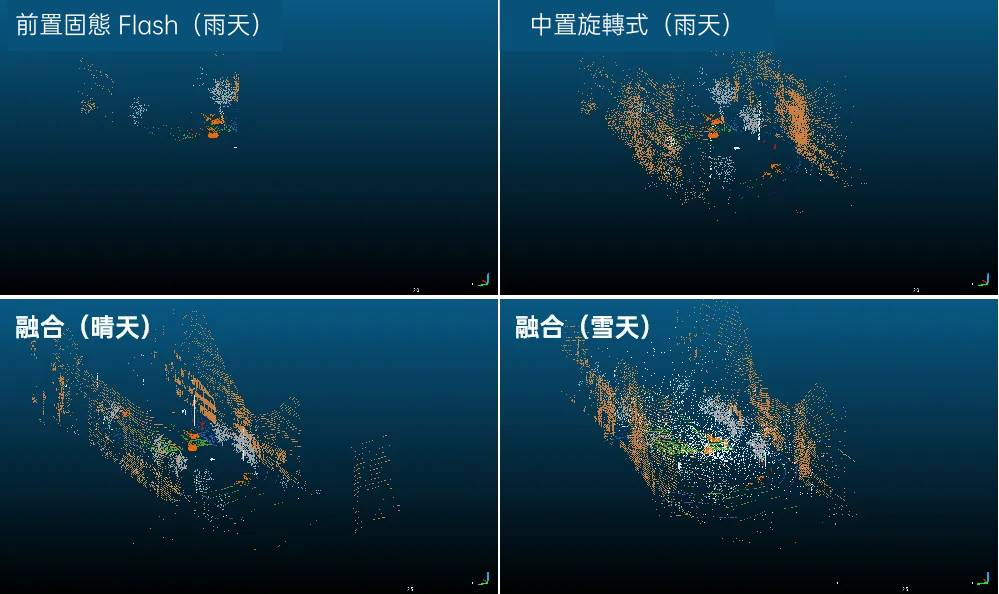

在雷達仿真方面,光達與毫米波雷達模型可依據雨、雪、霧等多種天候條件,真實重現感測器回波行為與量測特性,為高密度多目標偵測與連續追蹤任務,提供穩定且可靠的數據支援。

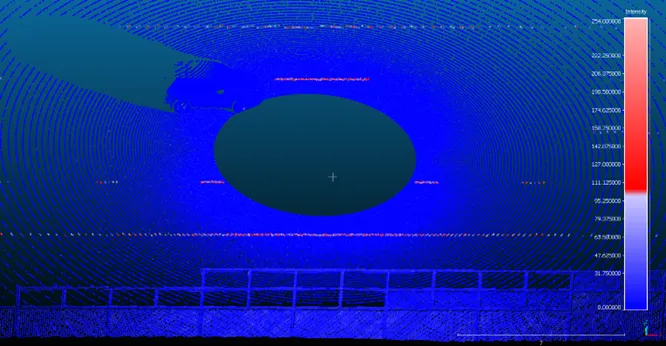

此外,系統亦支援材質層級的 BRDF(雙向反射分佈函數)建模,可更精細地呈現不同表面材質對雷射回波與反射特性的影響,進一步提升感測仿真結果與真實世界的一致性。

雷射雷達BRDF材質反射

雨雪天氣雷射雷達點雲輸出效應

毫米波雷達點雲

六、可靠度與仿真結果分析

我們針對本解決方案的仿真結果進行了完整且系統化的驗證。以車道線偵測任務為例,aiSim 仿真結果與真實世界資料之間的召回率高度一致,最高可達 98.45%。多項目標偵測任務的測試結果亦顯示,仿真輸出與實際路測表現具有高度相符性,特別是在遠距離目標偵測場景中,召回率表現尤為突出。

置信度測試1:車道線檢測算法

置信度測試2:多目標檢測

在多種測試環境下,端到端智慧駕駛仿真方案皆展現出穩定且可靠的測試表現,涵蓋車輛靜態與動態測試情境,並支援車輛模型與動力學模型的整合。透過 FMU(Functional Mock-up Unit)介面,可快速串接第三方動力學模型,加速測試流程與模型驗證效率。

動力學測量和建模

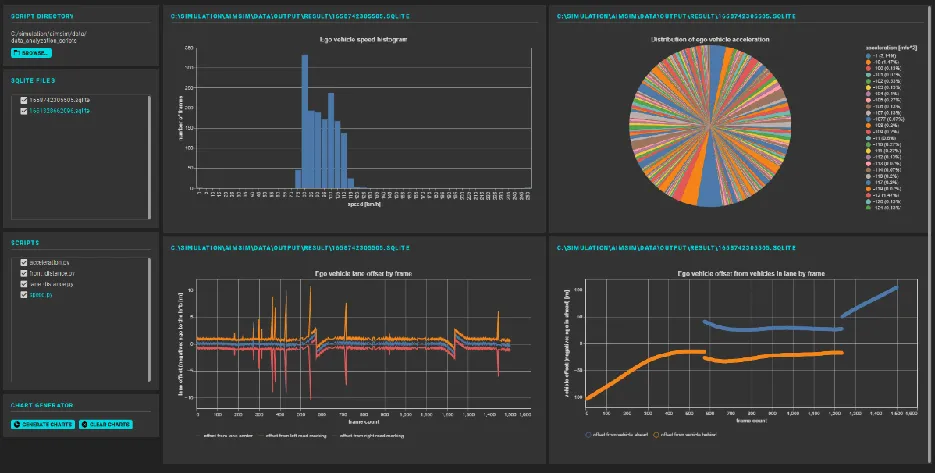

每次仿真測試完成後,系統皆會自動產生 SQLite 資料庫檔案,便於後續進行深入分析與數據探勘,確保測試結果在可追溯性、完整性與一致性上的可靠基礎。

測試結果可視化分析

七、宏虹應用案例分享

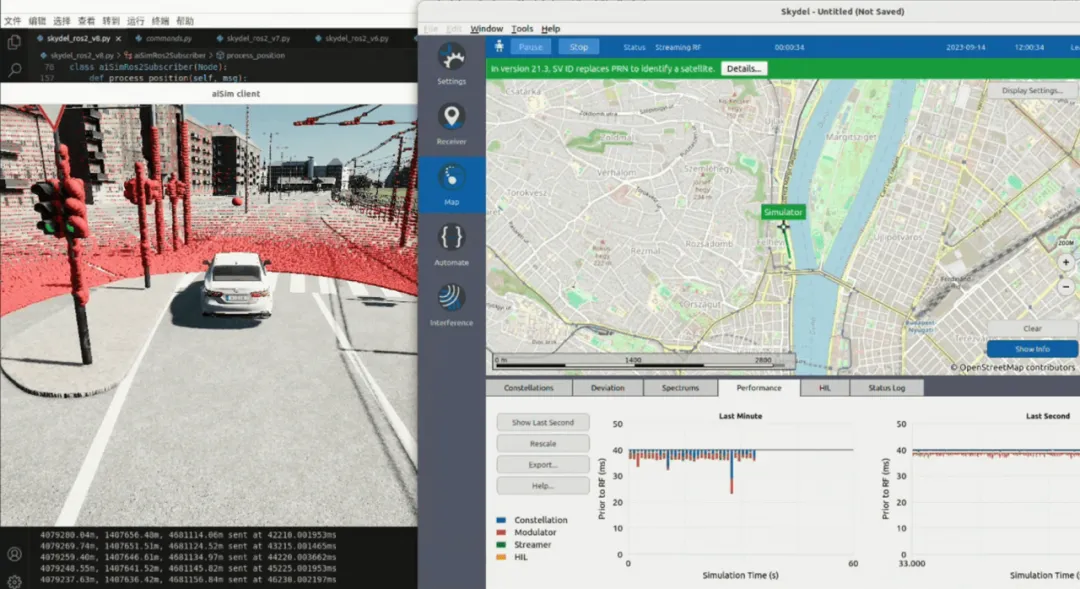

隨著自動駕駛測試需求日益多元,基於aiSim 核心引擎的端到端自動駕駛模擬解決方案,具備高度延展性與彈性架構,可支援 SIL / HIL 等多種應用測試情境,並可與 ROS2、Simulink、MATLAB 等主流開發與驗證平台無縫整合。支援車輛模型與動力學模型的整合。透過 FMU介面,可快速串接第三方動力學模型,加速測試流程與模型驗證效率。

基於DMA影像注入閉環測試方案及監測窗口

在實際應用上,我們進一步針對 GNSS 整合、控制器測試與決策功能快速驗證等關鍵場景進行模擬測試方案設計。透過高擬真感測器模型與完整情境重建能力,有效提升測試效率,同時降低對實體硬體與實車測試的依賴,協助研發團隊在開發早期即完成關鍵功能驗證,進而降低整體開發成本與風險。

GNSS聯合仿真方案

Learn more about our products

aiSim 智慧駕駛仿真平台

精準還原、高度擴展,打造自動駕駛研發與測試的一站式虛擬驗證平台

aiSim 專為自動駕駛與 ADAS 系統開發所設計,整合高擬真感測器模型、彈性場景建構與開放式介面架構,可有效支援從演算法開發、系統整合到 SiL/HiL 驗證的完整測試流程。透過虛擬環境快速重現複雜道路與極端情境,協助研發團隊在確保安全與可控的前提下,加速智慧駕駛系統的驗證與落地。

高擬真感測器仿真能力:支援 Camera、LiDAR、Radar、GNSS 等多感測器模型,真實還原不同天氣、光照與環境條件下的感測行為

彈性場景與測試配置:可依 ODD 條件快速組合場景元素,支援邊界案例與法規測試需求

支援端到端與模組化架構:同時滿足傳統感知-決策-控制流程與端到端學習式智駕架構驗證

開放式介面與生態整合:支援 ROS、Simulink、Matlab、第三方動力學模型與雲端/測試框架無縫銜接

降低實車測試風險與成本:透過高覆蓋率虛擬測試,提前暴露系統風險,加速產品迭代效率

Honghong will provide you with any support you need!

Our professional Honghong team will be the first to respond and provide you with the best service to solve all your problems.